Les réseaux de neurones artificiels : qu'est-ce que c'est et comment ça marche ?

- Stéphane Guy

- 3 févr.

- 10 min de lecture

Dernière mise à jour : 5 févr.

On parle beaucoup d'intelligence artificielle, de ChatGPT, de reconnaissance faciale ou encore de voitures autonomes. Mais derrière toutes ces technologies se cache un mécanisme fascinant : les réseaux de neurones artificiels. Inspirés par le fonctionnement de notre cerveau, ces systèmes révolutionnent la manière dont les machines apprennent. Mais concrètement, c'est quoi ? Comment ça fonctionne ? Et à quoi ça sert vraiment ?

En bref

Les réseaux de neurones artificiels imitent le fonctionnement du cerveau humain pour permettre aux machines d'apprendre et de prendre des décisions.

Ils sont composés de couches de neurones interconnectés qui traitent l'information de manière hiérarchique.

Leur histoire débute en 1943 avec les travaux de Warren McCulloch et Walter Pitts, bien avant l'existence des ordinateurs modernes.

Ils excellent dans la reconnaissance d'images, le traitement du langage et de nombreuses autres tâches complexes.

Malgré leurs performances, ils posent des questions éthiques autour de la transparence, des biais et de la responsabilité.

Leur démocratisation date des années 2010, grâce à l'augmentation de la puissance de calcul et aux grandes quantités de données disponibles.

C'est quoi un réseau de neurones artificiel ?

Une architecture inspirée du cerveau

Un réseau de neurones artificiel est un système informatique qui s'inspire, très schématiquement, du fonctionnement de notre cerveau. Concrètement, il s'agit d'"un ensemble organisé de neurones interconnectés”*

Comme le précise la CNIL, ces réseaux permettent “la résolution de problèmes complexes tels que la vision par ordinateur ou le traitement du langage naturel.”*

Dans le cerveau humain, les neurones biologiques transmettent des signaux électriques pour traiter l'information. De la même façon, les neurones artificiels reçoivent des données, les traitent via des calculs mathématiques, puis transmettent le résultat aux neurones suivants. Chaque connexion entre neurones possède un « poids », qui détermine l'importance du signal transmis.*

Un modèle mathématique avant tout

Ne nous y trompons pas : derrière l'appellation poétique de « réseau de neurones », il y a avant tout des mathématiques. Chaque neurone applique une fonction mathématique à ses données d'entrée. Cette fonction inclut une somme pondérée (multiplication des entrées par leurs poids respectifs) puis l'application d'une fonction d'activation qui décide si le neurone doit « s'activer » ou non.

Ce qui rend ces réseaux si puissants, c'est leur capacité à ajuster automatiquement ces poids au cours d'un processus d'apprentissage. C'est un peu comme si le système affinait progressivement sa compréhension du problème à résoudre, en se trompant d'abord beaucoup, puis de moins en moins.

Les différentes couches : entrée, cachées et sortie

Un réseau de neurones typique se compose de trois types de couches. La couche d'entrée reçoit les données brutes. Par exemple, les pixels d'une image si on veut reconnaître un chat. Les couches cachées effectuent le traitement proprement dit, en extrayant progressivement des caractéristiques de plus en plus abstraites. La couche de sortie produit le résultat final : dans notre exemple, la réponse « oui, c'est un chat » ou « non, ce n'est pas un chat ».*

Plus il y a de couches cachées, plus le réseau est profond. D'ailleurs, quand on parle de « deep learning » ou d'apprentissage profond, on fait référence à des réseaux possédant de nombreuses couches (parfois des centaines).

D'où viennent les réseaux de neurones ? Un peu d'histoire

1943 : les pionniers McCulloch et Pitts

L'histoire commence bien avant l'ère numérique telle qu'on la connaît. En 1943, le neurophysiologiste Warren McCulloch et le mathématicien Walter Pitts publient un article fondateur qui propose ce qui se rapproche du premier modèle mathématique de neurone artificiel.* À l'époque, les ordinateurs électroniques n'existaient même pas encore.

1958 : le perceptron de Rosenblatt

Quinze ans plus tard, le psychologue américain Frank Rosenblatt va plus loin en créant le perceptron, considéré comme le premier véritable réseau de neurones capable d'apprendre par expérience, même quand l’instructeur fait une erreur !*

*IBID

Les médias américains s'emballent. Le New York Times annonce une machine capable de tout reconnaître, de penser, voire de faire de l’exploration spatiale. L'enthousiasme est immense.*

*IBID

1969 : le coup d'arrêt de Minsky et Papert

Mais en 1969, deux mathématiciens, Marvin Minsky et Seymour Papert, publient un livre intitulé Perceptrons qui met en lumière les limites théoriques de ces systèmes. Ils démontrent notamment qu'un perceptron simple ne peut pas résoudre certains problèmes non linéaires, c’est-à-dire des événements qui ne se produisent pas de manière “proportionnelle” ou tout à fait logique qui, finalement, composent la majorité des événements de la vie réelle.*

*IBID

Cet ouvrage aura un impact dévastateur. Les recherches sur les réseaux de neurones s'effondrent, les financements disparaissent. Cet événement est situé juste 1 an avant les années 1970, où débuta le premier “hiver de l’IA” : une période où les recherches, les financements et l’engouement pour l’intelligence artificielle connurent un fort ralentissement. On explique toute cette période dans notre article sur l’histoire de l’IA.

Les années 1980 : la renaissance

Il faudra attendre les années 1980 pour que les réseaux de neurones refassent surface. En 1986, David Rumelhart, Ronald J. Williams et Geoffrey Hinton popularisent l'algorithme de rétropropagation du gradient, une méthode qui permet d'entraîner efficacement des réseaux multicouches et de penser au développement d’un véritable réseau de neurones.*

*IBID

Avec le développement de l'électronique numérique et l'augmentation de la puissance de calcul, les réseaux de neurones connaissent un nouvel essor. Mais il leur manque encore un élément crucial : les données.

2012 : le tournant du deep learning

Le véritable décollage arrive au début des années 2010. “En 2012, lors d’une compétition organisée par ImageNet, un Neural Network est parvenu pour la première fois à surpasser un humain dans la reconnaissance d’image.”*

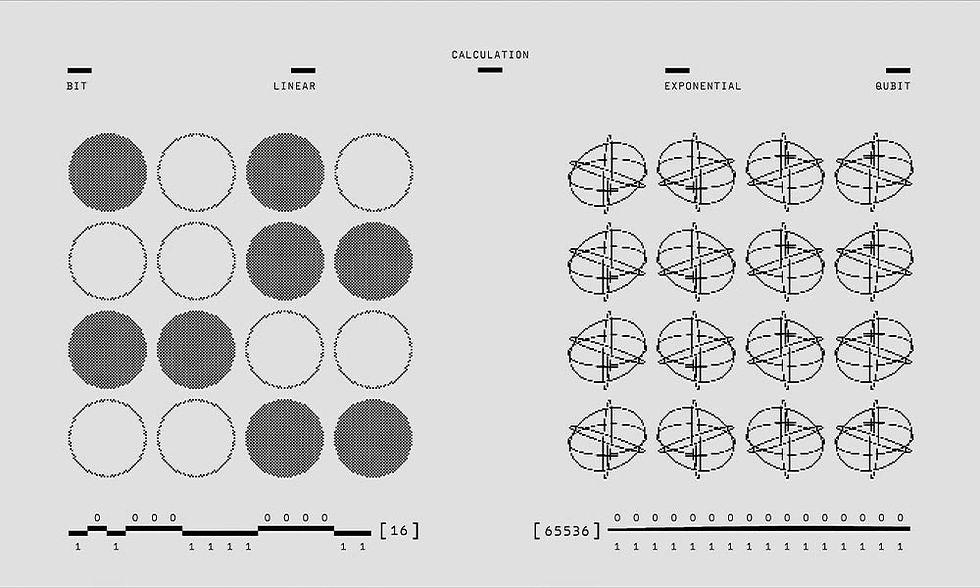

Pourquoi ce succès soudain ? Deux raisons principales : l'explosion du Big Data fournit enfin les quantités massives de données nécessaires à l'apprentissage, et les processeurs graphiques (GPU) offrent la puissance de calcul requise pour traiter ces données. Depuis, les réseaux de neurones ne cessent de progresser et sont devenus la colonne vertébrale de la plupart des systèmes d'intelligence artificielle modernes.

Comment fonctionne un réseau de neurones en pratique ?

L'apprentissage : le cœur du système

Contrairement à un programme informatique classique, un réseau de neurones n'est pas programmé pour résoudre un problème précis. Il apprend à le résoudre en observant des exemples.

Prenons un cas concret : vous voulez créer un réseau capable de distinguer des photos de chiens et de chats. Vous allez lui montrer des milliers d'images déjà étiquetées (« chien » ou « chat »). Au début, le réseau va se tromper énormément. Mais à chaque erreur, un algorithme va ajuster légèrement les poids des connexions entre neurones pour améliorer les résultats.

C'est un processus itératif. Après avoir vu suffisamment d'exemples et corrigé suffisamment d'erreurs, le réseau finit par « comprendre » ce qui caractérise un chien par rapport à un chat : les oreilles, la forme du museau, la posture...

La rétropropagation du gradient

L'algorithme qui permet cet apprentissage s'appelle la rétropropagation du gradient. Son principe ? Calculer l'erreur commise par le réseau sur sa prédiction, puis « propager » cette erreur en arrière, de la couche de sortie vers les couches précédentes, en ajustant les poids au passage.*

C'est un peu comme si vous appreniez à jouer aux fléchettes : chaque lancer raté vous donne une indication sur comment ajuster votre geste pour vous rapprocher de la cible.

Les différents types de réseaux

Il existe plusieurs architectures de réseaux de neurones, chacune adaptée à des tâches spécifiques.

Les réseaux à propagation avant (feedforward) sont les plus simples : l'information circule uniquement dans un sens, de l'entrée vers la sortie. *

Les réseaux de neurones convolutifs (CNN) excellent dans le traitement d'images. Ils utilisent des filtres qui « scannent » l'image pour détecter des motifs locaux comme des contours ou des textures.*

Les réseaux de neurones récurrents (RNN) sont conçus pour les données séquentielles comme le texte ou la parole. Ils possèdent une sorte de « mémoire » qui leur permet de prendre en compte le contexte.*

À quoi servent concrètement les réseaux de neurones ?

La reconnaissance d'images et de vidéos

C'est sans doute l'application la plus spectaculaire. Les réseaux de neurones convolutifs permettent de reconnaître des objets, des visages, voire de diagnostiquer des maladies à partir d'imagerie médicale.

Sur votre smartphone, c'est grâce à eux que votre appareil photo peut identifier automatiquement que vous photographiez un coucher de soleil et ajuster les réglages en conséquence.

Dans le domaine médical, les réseaux de neurones analysent des radiographies ou des IRM pour détecter des tumeurs ou des anomalies avec une précision de plus en plus élevée. L’IA est également utilisée dans le domaine spatial et l’observation de la terre pour détecter des anomalies ou observer les étoiles. On en parle dans notre article sur l’IA et l’exploration spatiale.

Le traitement du langage naturel

ChatGPT, Google Translate, les assistants vocaux comme Siri ou Alexa : tous reposent sur des réseaux de neurones. Ces systèmes peuvent comprendre le langage humain, traduire des textes, générer des résumés automatiques ou même rédiger des articles.

Ce qui est fascinant, c'est que ces réseaux n'ont pas été programmés avec des règles de grammaire ou de syntaxe. Ils ont simplement « lu » des milliards de phrases et appris par eux-mêmes les structures du langage.

La conduite autonome

Tesla et d'autres constructeurs utilisent des réseaux de neurones pour permettre à leurs voitures de « voir » et comprendre leur environnement. Les caméras embarquées capturent des images en temps réel, et le réseau identifie les autres véhicules, les piétons, les panneaux de signalisation...*

C'est un exploit technique remarquable, mais qui soulève aussi des questions : que se passe-t-il en cas d'erreur ? Qui est responsable ?

La finance et la détection de fraudes

Dans le secteur bancaire, les réseaux de neurones analysent des millions de transactions pour détecter des comportements suspects qui pourraient indiquer une fraude. Ils peuvent aussi prédire les tendances du marché ou évaluer le risque de crédit d'un emprunteur.

La création de contenu

Des outils comme DALL-E, Midjourney ou Stable Diffusion utilisent des réseaux de neurones pour générer des images à partir de descriptions textuelles. Suno AI, dont nous avons déjà parlé sur 360°IA, peut créer des musiques complètes avec ou sans paroles. Les possibilités semblent infinies. Mais cette puissance s'accompagne aussi de défis importants.

Les limites et défis des réseaux de neurones

Le problème de la « boîte noire »

L'un des plus gros problèmes des réseaux de neurones profonds, c'est leur opacité. On sait ce qu'on leur donne en entrée (des données) et ce qu'on récupère en sortie (une prédiction), mais ce qui se passe entre les deux reste largement mystérieux.

Même les chercheurs qui créent ces systèmes ont du mal à expliquer pourquoi un réseau a pris telle décision plutôt qu'une autre. Cette opacité pose problème dans des domaines critiques comme la médecine, la justice ou la finance, où il est indispensable de pouvoir justifier une décision.

Imaginez : une IA refuse votre demande de prêt bancaire. Vous demandez pourquoi. La réponse ? « L'algorithme en a décidé ainsi. » Pas très satisfaisant, n'est-ce pas ?

Les biais algorithmiques

Les réseaux de neurones apprennent à partir de données. Si ces données contiennent des biais, le réseau les reproduira, voire les amplifiera.

Par exemple, si on entraîne un réseau à trier des CV avec des données historiques où les hommes étaient systématiquement favorisés, le réseau risque d'apprendre que les candidats masculins sont préférables.

Cela est déjà arrivé dans la vraie vie. Amazon a dû abandonner un système de recrutement par IA qui discriminait les femmes, précisément parce qu'il avait été entraîné sur des données biaisées.*

La consommation de ressources

Entraîner un réseau de neurones profond nécessite une puissance de calcul colossale et consomme énormément d'énergie. Certains modèles de langage récents ont des empreintes carbone comparables à plusieurs vols transatlantiques. C'est un enjeu environnemental qu'on ne peut pas ignorer et qu’on étudie dans notre article sur le coût environnemental de l’IA.

Le risque de sur-apprentissage

Un réseau peut devenir tellement spécialisé dans ses exemples d'entraînement qu'il perd sa capacité à généraliser à de nouvelles situations. C'est ce qu'on appelle le sur-apprentissage ou « overfitting ».*

C'est un peu comme un étudiant qui apprendrait par cœur les réponses à des exercices sans vraiment comprendre les concepts sous-jacents : ça marche pour les exercices connus, mais pas pour les nouveaux problèmes.

Vers une IA plus éthique et transparente ?

L'IA explicable (XAI)

Face au problème de la boîte noire, des chercheurs développent des techniques d'IA explicable (XAI) qui permettent de mieux comprendre comment les réseaux prennent leurs décisions.*

La régulation

L'Union européenne a publié en 2024 l'AI Act, un règlement qui encadre l'utilisation de l'intelligence artificielle et exige notamment une certaine explicabilité pour les systèmes à haut risque.

Le RGPD garantit aussi un droit à “ne pas faire l'objet d'une décision fondée exclusivement sur un traitement automatisé, y compris le profilage, produisant des effets juridiques la concernant ou l'affectant de manière significative de façon similaire.”*

Ces cadres réglementaires sont essentiels pour éviter les dérives, mais ils doivent trouver l'équilibre entre protection et innovation.

La diversité dans les équipes

Pour réduire les biais, il faut de la diversité dans les équipes qui conçoivent les IA. Si seul un groupe homogène développe ces systèmes, les angles morts seront nombreux.

FAQ

Un réseau de neurones, c'est vraiment comme un cerveau humain ?

Non, c'est une simplification. Les réseaux de neurones artificiels s'inspirent très schématiquement du fonctionnement cérébral, mais restent avant tout des modèles mathématiques. Le cerveau humain est infiniment plus complexe et fonctionne selon des principes que nous ne comprenons pas encore totalement.

Est-ce qu'un réseau de neurones peut apprendre tout seul, sans intervention humaine ?

Oui et non. Un réseau peut ajuster automatiquement ses paramètres pendant l'apprentissage, mais il a besoin de données préparées par des humains, d'une architecture définie par des humains, et d'objectifs fixés par des humains. L'autonomie est donc relative.

Pourquoi les réseaux de neurones ont-ils mis si longtemps à se démocratiser ?

Principalement à cause des limitations technologiques. Même si les concepts existaient depuis les années 1940, les ordinateurs n'avaient pas la puissance nécessaire pour entraîner des réseaux complexes, et les données manquaient. Ce n'est qu'avec l'arrivée du Big Data et des GPU dans les années 2010 que tout a décollé.

Les réseaux de neurones vont-ils remplacer les humains dans certains métiers ?

Certaines tâches répétitives ou basées sur la reconnaissance de motifs risquent effectivement d'être automatisées. Mais les réseaux de neurones manquent de créativité, de sens éthique, et de compréhension contextuelle. Ils sont plutôt des outils qui augmentent les capacités humaines que des remplaçants.

Comment savoir si une décision prise par une IA est juste ?

C'est justement tout l'enjeu de l'IA explicable et de la régulation. Pour l'instant, il n'existe pas de réponse parfaite. La transparence, les audits indépendants et l'implication humaine dans les décisions critiques sont des pistes importantes pour limiter les risques.

Peut-on faire confiance à un réseau de neurones ?

Ça dépend du contexte. Pour trier vos photos de vacances, sans problème. Pour décider d'un diagnostic médical ou d'une peine de prison ? Il faut beaucoup plus de prudence, de supervision humaine et de garanties éthiques. La confiance ne doit jamais être aveugle.

Commentaires